Så påverkas vårt omdöme – när AI tar våra beslut

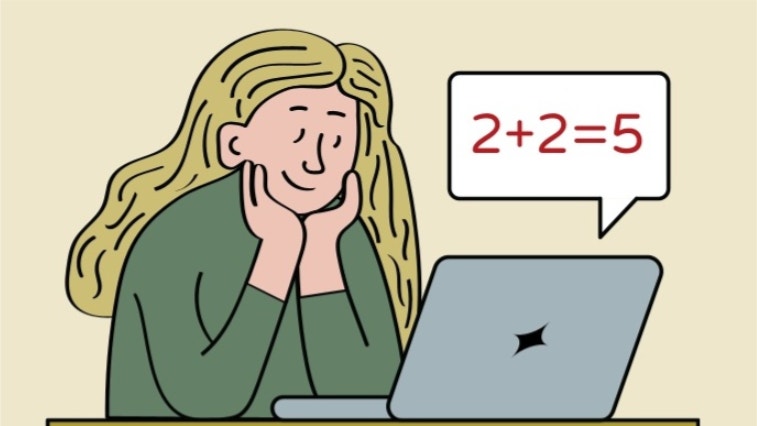

Nästa gång du frågar Chat GPT om råd – stannar du upp och ifrågasätter svaret? Troligtvis inte. Det är slutsatsen i en ny studie från Wharton School vid University of Pennsylvania, där forskarna Steven Shaw och Gideon Nave myntar begreppet ”kognitiv kapitulation” – tendensen att okritiskt svälja vad AI serverar oss, oavsett om det stämmer eller inte.

Studien, som omfattar tre experiment med totalt 1 372 deltagare, är uppbyggd kring ett enkelt men elegant test. Deltagarna fick lösa logikproblem med eller utan tillgång till en AI-assistent, vars svar i hemlighet hade manipulerats av forskarna. Ibland hade AI:n rätt – ibland fel.

När AI:n hade rätt steg träffsäkerheten med 25 procentenheter jämfört med kontrollgruppen. När den hade fel rasade den med 15 procentenheter – långt under vad deltagarna presterade helt på egen hand. Trots detta rapporterade deltagarna genomgående högt självförtroende när de använde AI, även i de fall där svaren var felaktiga.

De är mest utsatta

Mest utsatta för kognitiv kapitulation var personer med hög tillit till AI och svag analytisk förmåga. Tidspress förvärrade mönstret ytterligare, vilket enligt forskarna förklaras av att vi under stress i ännu högre grad söker den enklaste vägen till ett svar. Ekonomiska incitament kombinerat med direkt återkoppling visade sig däremot delvis kunna motverka kapitulationen – när deltagarna fick veta om de hade rätt eller fel, och hade något att vinna på att anstränga sig, ökade benägenheten att ifrågasätta AI:ns svar.

Steven Shaw och Gideon Nave vill uppdatera den etablerade modellen för mänskligt tänkande, som traditionellt delar in kognition i två system: det snabba och intuitiva, respektive det långsamma och analytiska. Till dessa lägger de nu ett tredje – den artificiella kognitionen.